Погрешности в нейронных сетях

Метод обратного распространения точности для гарантированных интервальных оценок

Пусть нам заданы допустимые погрешности вычислений для выходных сигналов сети. Для каждого элемента решим задачу: определить допустимые погрешности на входах элемента по заданным максимально допустимым погрешностям на его выходе. Если эту задачу решить для каждого элемента сети, то можно оценить допустимые погрешности для всех сигналов, проходящих через сеть, переходя по сети от элемента к элементу в обратном направлении (от выходов сети к ее входам). Этот процесс мы назовем обратным распространением точности. В ходе него движение сигналов происходит от выходов ко входам, сигнал, проходящий по связи в обратном направлении, является допустимой погрешностью сигнала, проходящего по этой связи в прямом направлении.

Последним элементом стандартного нейрона является точка ветвления, поэтому начинаем рассмотрение метода обратного распространения точности именно с нее.

Точка ветвления имеет несколько выходов. Пусть для каждого ее выхода задана допустимая погрешность  ( i - номер выхода). Для того, чтобы удовлетворить всем этим ограничениям погрешности, необходимо и достаточно, чтобы входной сигнал точки ветвления имел погрешность

( i - номер выхода). Для того, чтобы удовлетворить всем этим ограничениям погрешности, необходимо и достаточно, чтобы входной сигнал точки ветвления имел погрешность  . Таким образом, при обратном распространении точности точка ветвления заменяется на двойственный элемент, выбирающий из поступающих сигналов

. Таким образом, при обратном распространении точности точка ветвления заменяется на двойственный элемент, выбирающий из поступающих сигналов  (т.е. погрешностей) минимальный.

(т.е. погрешностей) минимальный.

Следующим элементом стандартного нейрона является нелинейный преобразователь. Пусть входной сигнал нелинейного преобразователя равен  ,

,  - его функция активации,

- его функция активации,  - выходной сигнал и

- выходной сигнал и  - допустимая погрешность выходного сигнала. Вычислим максимальную погрешность

- допустимая погрешность выходного сигнала. Вычислим максимальную погрешность  входного сигнала нелинейного преобразователя, то есть найдем отрезок

входного сигнала нелинейного преобразователя, то есть найдем отрезок ![[A_0 - \varepsilon ,A_0 + \varepsilon]](/sites/default/files/tex_cache/c9e2c00eecc4532c05ba3dfedfd6289c.png) такой, что для любого

такой, что для любого ![x \in [A_0 - \varepsilon ,A_0 + \varepsilon ]](/sites/default/files/tex_cache/d15531c093b3260ca61ff4fe0d1433a6.png)

отличается от

отличается от  не более, чем на

не более, чем на  :

:  .

.

Ввиду непрерывности и дифференцируемости функции активации нелинейного преобразователя очевидно, что  , где

, где

![x \in [\varphi^{-1}(y - \varepsilon_1 ),\varphi^{- 1}(y + \varepsilon_1 )].](/sites/default/files/tex_cache/2619a24c5f0f66eec821eafebdc47a2c.png)

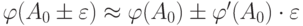

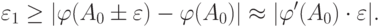

Пойдем традиционным путем, оценивая допустимую погрешность в линейном приближении:  . По условию

. По условию

Пользуясь этим неравенством, подберем  следующим образом:

следующим образом:  . В этом случае формула для вычисления допустимой погрешности более простая, но менее точная.

. В этом случае формула для вычисления допустимой погрешности более простая, но менее точная.

Получили погрешность, допустимую для входного сигнала нелинейного преобразователя, которая одновременно является допустимой погрешностью для выходного сигнала сумматора. Аналогично можем вычислить погрешность входного сигнала нелинейного преобразователя любого стандартного нейрона, если известна погрешность его выходного сигнала.

Двойственный к нелинейному преобразователю элемент - просто линейная связь! Ее вес равен  для линейного приближения в формуле ошибки или

для линейного приближения в формуле ошибки или  - в более общем случае (в последней формуле максимум берется по отрезку

- в более общем случае (в последней формуле максимум берется по отрезку ![x \in [\varphi^{- 1}(y - \varepsilon_1 ),\varphi^{- 1}(y + \varepsilon_1 )]](/sites/default/files/tex_cache/33a70f66f395169e0c942542a523a1cf.png) - так что линейность здесь уже кажущаяся).

- так что линейность здесь уже кажущаяся).

Перейдем к следующему элементу стандартного нейрона - адаптивному сумматору с  синапсами, являющимися его входами. Адаптивный сумматор - это сумматор, в котором входные сигналы

синапсами, являющимися его входами. Адаптивный сумматор - это сумматор, в котором входные сигналы  суммируются с весами

суммируются с весами  .

.

Каждый вход  сумматора

сумматора  имеет некоторую погрешность

имеет некоторую погрешность  , которая вносит свой вклад в допустимую погрешность выходного сигнала сумматора. Эти погрешности могут иметь различные величины в зависимости от того, какой способ распределения допустимой погрешности выходного сигнала по входам сумматора мы выберем. Погрешности по входам сумматора могут распределяться равномерно, пропорционально и приоритетно.

, которая вносит свой вклад в допустимую погрешность выходного сигнала сумматора. Эти погрешности могут иметь различные величины в зависимости от того, какой способ распределения допустимой погрешности выходного сигнала по входам сумматора мы выберем. Погрешности по входам сумматора могут распределяться равномерно, пропорционально и приоритетно.

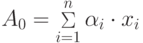

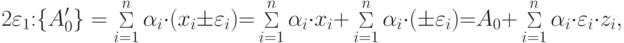

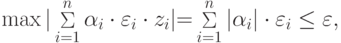

Рассмотрим сначала равномерное распределение. Для этого полагаем, что на всех входах погрешности равны между собой  . Пусть

. Пусть  - выходной сигнал сумматора без погрешностей. Тогда

- выходной сигнал сумматора без погрешностей. Тогда  - множество выходных сигналов сумматора, получающихся, когда вектор входных сигналов сумматора пробегает вершины

- множество выходных сигналов сумматора, получающихся, когда вектор входных сигналов сумматора пробегает вершины  - мерного куба с центром в точке

- мерного куба с центром в точке  и ребром длины

и ребром длины

. Нам требуется, чтобы все множество значений

. Нам требуется, чтобы все множество значений  попало в интервал

попало в интервал ![[A_0 - \varepsilon ,A_0 + \varepsilon ]](/sites/default/files/tex_cache/5f8ad3c68eb4cd99fe0d41ac6d602e8e.png) . Для этого необходимо, чтобы

. Для этого необходимо, чтобы

. Из этого неравенства и сделанного выше предположения о

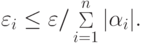

. Из этого неравенства и сделанного выше предположения о  получаем требуемую оценку для равномерного распределения

получаем требуемую оценку для равномерного распределения  по входам сумматора:

по входам сумматора:

При пропорциональном распределении погрешностей допустимая погрешность выходного сигнала сумматора делится сначала на число входов, а затем для каждого входа делится на соответствующий вес синапса. То есть погрешности распределяются пропорционально весам соответствующих синапсов. Формула расчета допустимой погрешности для каждого входа сумматора имеет вид:  , где

, где  - допустимая погрешность выходного сигнала сумматора,

- допустимая погрешность выходного сигнала сумматора,  - число входов сумматора,

- число входов сумматора,  - веса синапсов соответствующих входов сумматора.

- веса синапсов соответствующих входов сумматора.

При приоритетном распределении погрешностей сначала назначаются погрешности для тех входов, которые наиболее значимы по какому-либо признаку, а затем оставшуюся часть допустимой погрешности выходного сигнала сумматора распределяют между оставшимися входами равномерно или пропорционально.

Аналогично можно вычислить допустимые погрешности для входных сигналов сумматора любого стандартного нейрона, если известны погрешности для выходного сигнала сумматора.